Πρέπει να ανησυχούμε για την τεχνητή νοημοσύνη;

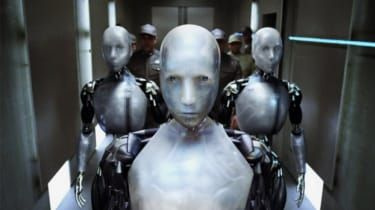

Σε βάθος: η άνοδος των ρομπότ τεχνητής νοημοσύνης θα μπορούσε να δημιουργήσει ή να καταστρέψει το μέλλον της ανθρωπότητας

Τα έξυπνα ρομπότ εκτελούν έναν αυξανόμενο αριθμό ρόλων

Getty Images

Η επιτυχία στη δημιουργία αποτελεσματικής τεχνητής νοημοσύνης θα μπορούσε να είναι το μεγαλύτερο γεγονός στην ιστορία του πολιτισμού μας. Ή το χειρότερο. Απλώς δεν ξέρουμε, είπε ο καθηγητής Στίβεν Χόκινγκ στη Σύνοδο Κορυφής Ιστού αυτής της εβδομάδας στη Λισαβόνα.

Μαζί με πολλά οφέλη, είπε ο Χόκινγκ, η τεχνητή νοημοσύνη (AI) φέρνει πολλούς κινδύνους, όπως ισχυρά αυτόνομα όπλα ή νέους τρόπους για τους λίγους να καταπιέζουν τους πολλούς.

Ο φυσικός ζήτησε νέο κανονισμό για να διασφαλιστεί ότι η ανθρωπότητα θα μπορούσε να αποτρέψει την τεχνητή νοημοσύνη από το να απειλήσει την ύπαρξή της.

Ίσως θα έπρεπε όλοι να σταματήσουμε για μια στιγμή και να επικεντρωθούμε όχι μόνο στο να κάνουμε την τεχνητή νοημοσύνη μας καλύτερη και πιο επιτυχημένη, αλλά και στο όφελος της ανθρωπότητας, πρόσθεσε.

Ο Χόκινγκ δεν είναι ο μόνος φωτιστής από τον κόσμο της επιστήμης και της τεχνολογίας που έχει προειδοποιήσει για το μέλλον της τεχνητής νοημοσύνης.

Θα πρέπει όλοι να είμαστε πολύ προσεκτικοί με την τεχνητή νοημοσύνη, Μπιλ Γκέϊτς είπε νωρίτερα φέτος. Αν έπρεπε να μαντέψω ποια είναι η μεγαλύτερη υπαρξιακή μας απειλή, μάλλον αυτό είναι. Με την τεχνητή νοημοσύνη, καλούμε τον δαίμονα».

Τους τελευταίους μήνες, υπήρξαν τίτλοι σχετικά με τα ρομπότ δολοφόνων και την αυτοματοποίηση που αντικαθιστά τους ανθρώπινους εργάτες, αλλά και για αλγόριθμους που βοηθούν στη διάγνωση του καρκίνου και την επιτυχή ανάπτυξη αυτοοδηγούμενων αυτοκινήτων.

Μερικοί μελετητές υποστηρίζουν ότι είναι ο πιο πιεστικός υπαρξιακός κίνδυνος που μπορεί να αντιμετωπίσει ποτέ η ανθρωπότητα, ενώ άλλοι απορρίπτουν ως επί το πλείστον τον υποτιθέμενο κίνδυνο ως αβάσιμο μοιρολόι, λέει Μητρική πλακέτα του Φιλ Τόρες.

Πρέπει λοιπόν να ανησυχούμε για την εξάπλωση της τεχνητής νοημοσύνης; Και τι μπορούμε να κάνουμε για αυτό;

Η αντίδραση στο AI

ΠΡΟΣ ΤΟ YouGov έρευνα πέρυσι σε περισσότερα από 2.000 άτομα διαπίστωσε ότι η στάση του κοινού απέναντι στην τεχνητή νοημοσύνη ποικίλλει σημαντικά ανάλογα με την εφαρμογή της.

Περίπου το 70% των ερωτηθέντων χαιρόταν που τα έξυπνα μηχανήματα εκτελούν φαινομενικά ταπεινές εργασίες, όπως η παρακολούθηση των καλλιεργειών – αλλά αυτό μειώθηκε στο 49% όταν επρόκειτο για οικιακές εργασίες, ενώ μόνο το 23% θα ήταν χαρούμενο για τα ρομπότ να εκτελούν ιατρικές πράξεις. Και μόλις το 17% αισθάνονταν άνετα με την ιδέα των λεγόμενων ρομπότ του σεξ.

Μία από τις κύριες ανησυχίες για την τεχνητή νοημοσύνη είναι η απρόσωπη φύση της.

Τον Αύγουστο, ο Διευθύνων Σύμβουλος της Tesla και της SpaceX, Έλον Μασκ, μαζί με άλλους 115 ειδικούς τεχνητής νοημοσύνης και ρομποτικής, υπέγραψε ανοιχτή επιστολή προτρέποντας τον ΟΗΕ να αναγνωρίσει τους κινδύνους των φονικών αυτόνομων όπλων και να απαγορεύσει τη χρήση τους διεθνώς.

Σύμφωνα με την Παρατηρητήριο Ανθρωπίνων Δικαιωμάτων Ο οργανισμός, οι ΗΠΑ, η Κίνα, το Ισραήλ, η Νότια Κορέα, η Ρωσία και το Ηνωμένο Βασίλειο έχουν επενδύσει στην ανάπτυξη οπλικών συστημάτων με μειωμένα επίπεδα ανθρώπινου ελέγχου στις κρίσιμες λειτουργίες της επιλογής και της εμπλοκής στόχων.

Στίβεν Φίνλεϊ , συγγραφέας του Artificial Intelligence and Machine Learning for Business, πιστεύει ότι αυτόνομα οπλισμένα ρομπότ που μπορούν να παρακολουθούν και να στοχεύουν ανθρώπους, χρησιμοποιώντας λογισμικό αναγνώρισης προσώπου, βρίσκονται προ των πυλών.

Η τεχνητή νοημοσύνη και η ρομποτική προχωρούν τόσο γρήγορα που μέσα σε χρόνια, οι πόλεμοι θα μπορούσαν να γίνουν με αυτόνομα όπλα και οχήματα. Ο κηδεμόνας .

Ρύθμιση ή εξόντωση;

Η ρύθμιση της τεχνητής νοημοσύνης είναι μια απάντηση στο πρόβλημα.

Μια υγιής σύγχρονη δημοκρατία απαιτεί από τους απλούς πολίτες να συμμετέχουν σε δημόσιες συζητήσεις σχετικά με τις ταχέως εξελισσόμενες τεχνολογίες. Χρειαζόμαστε απεγνωσμένα νέες πολιτικές, κανονισμούς και δίχτυα ασφαλείας για όσους εκτοπίζονται από μηχανήματα, λέει Το έθνος της Katharine Dempsey.

Ο Έλον Μασκ συμφωνεί. Πίσω το 2014, είπε: Έχω την τάση να πιστεύω ότι πρέπει να υπάρχει κάποια ρυθμιστική εποπτεία, ίσως σε εθνικό και διεθνές επίπεδο, μόνο και μόνο για να βεβαιωθούμε ότι δεν θα κάνουμε κάτι πολύ ανόητο.

Αναμφισβήτητα, η μεγαλύτερη ανησυχία είναι ότι οι μηχανές μπορεί να γίνουν καλύτερες στη λήψη αποφάσεων από τους ανθρώπους, υποδουλώνοντας την ανθρωπότητα στους αυτοματοποιημένους φορείς λήψης αποφάσεων και σε όποιον τους ελέγχει.

Τα συστήματα που βασίζονται σε AI αντικαθιστούν ήδη πολλές θέσεις εργασίας. Για παράδειγμα, ορισμένα μηχανήματα τεχνητής νοημοσύνης μπορούν να εντοπίσουν τον καρκίνο του δέρματος με την ίδια ακρίβεια με έναν γιατρό, Ενσύρματο Αναφορές.

Πολλές από τις επιλογές μας έχουν ήδη επηρεαστεί από την τεχνητή νοημοσύνη, μέσω ιστοσελίδων όπως το Amazon και το Facebook. Οι αλγόριθμοι καθορίζουν το περιεχόμενο που βλέπουμε στο διαδίκτυο και κάνουν συστάσεις για τα πάντα, από το τι βλέπουμε στην τηλεόραση και το πού τρώμε μέχρι το ποιοι βγαίνουμε ραντεβού.

Αυτό που κάνει αυτό το σενάριο τόσο επικίνδυνο είναι ότι δεν σχεδιάζεται από κάποιον κυρίαρχο αρχηγό πληροφοριών ή μηχανών, λέει ο Steven Finlay. Δημιουργούμε την ίδια την τεχνολογία που θα μπορούσε να οδηγήσει στον αφανισμό μας.

Μια αλλαγή προς το καλύτερο;

Δεν είναι όλα καταστροφή και καταστροφή.

Είμαι αισιόδοξος ότι μπορούμε να δημιουργήσουμε ένα εμπνευσμένο μέλλον με την τεχνητή νοημοσύνη αν κερδίσουμε τον αγώνα μεταξύ της αυξανόμενης δύναμης της τεχνητής νοημοσύνης και της αυξανόμενης σοφίας με την οποία το διαχειριζόμαστε, αλλά αυτό θα απαιτήσει σχεδιασμό και δουλειά, ο φυσικός Max Tegmark, συγγραφέας του Life 3.0: Το να είσαι άνθρωπος στην εποχή της τεχνητής νοημοσύνης, είπε Μητρική πλακέτα .

Ενώ ο Tegmark υποστηρίζει τη ρύθμιση, υποστηρίζει ότι πρέπει επίσης να δοθεί έμφαση στα θετικά της χρήσης AI. Εάν οι άνθρωποι εστιάζουν μόνο στα μειονεκτήματα, παραλύουν από τον φόβο και η κοινωνία πολώνεται και διασπάται, καταλήγει.